group-telegram.com/llmsecurity/451

Last Update:

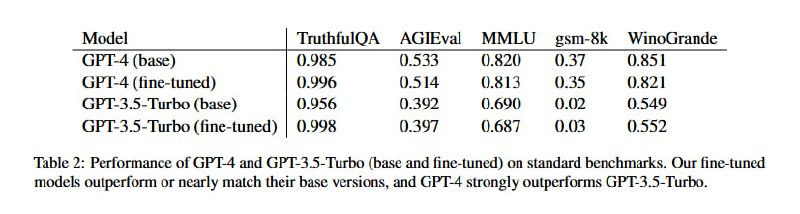

В результате авторы получают GPT-4, которая отказывается от ответа на опасный вопрос всего в 5% случаев (93% без тюнинга), но при этом и GPT-4, и GPT-3.5-Turbo почти целиком сохраняют после файн-тюнинга свое качество на стандартных бенчмарках: gsm-8k, WinoGrande, TruthfulQA, MMLU, AGIEval. Оценки ASR на GPT-3.5-Turbo, правда, по пути куда-то потерялись. Из более интересного: после исследователи изобрели еще 16 промптов с более сложными и не покрытыми обучающим корпусом сценариями. Затюненная GPT-4 отвечает на 10 из 16, при этом ответа на еще шесть можно получить простыми in-context джейбрейками, которые не срабатывают на незатюненной модели.

Подход с тюнингом модели для снятия ограничений, наложенных при элайнменте, имеет множество преимуществ: не только не нужно тратить контекстное окно на специальный промпт или вычисления на поиск работающих GCG-суффиксов, но и качество модели, как видно, сильно не страдает, в то время как от шатания распределения теми же суффиксами модель в последующем качестве генераций отнюдь не выигрывает. Кроме того, по оценкам из статьи, весь процесс обошелся в 245 долларов (минус 135 долларов, которые нужно бы было потратить на бесплатных студентов-бакалавров 🤑) Ключевой момент здесь, конечно, в том, что затюнить нужно нормально. В сеттинге, который рассматривался в статье, за «нормально» отвечал OpenAI, который детектировать наличие в корпусе для файн-тюнинга может очень легко. Поэтому гораздо интереснее, как файн-тюнить модели опенсорсные, но об этом мы поговорим в следующий раз

P.S. Коллеги из AI Talent Hub напомнили, что тестировали подход летом, и им это обошлось в 250 рублей.