group-telegram.com/artificial_stupid/330

Last Update:

#interpretable_ml

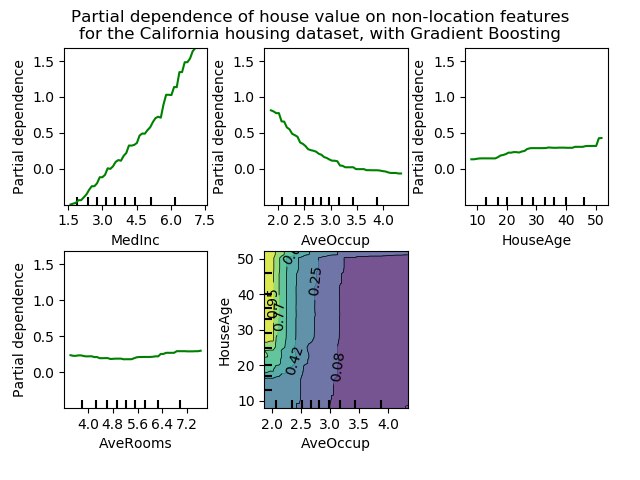

Partial dependence plot (PDP) - это инструмент для визуализации влияния одной или нескольких переменных на прогнозируемую переменную в модели машинного обучения. PDP показывает, как изменяется ожидание прогноза при изменении значения одного или нескольких признаков. Интуитивно мы можем интерпретировать частичную зависимость как ожидаемый целевой отклик в зависимости от интересующих входных признаков. PDP может помочь понять, как модель учитывает различные факторы и какие из них являются наиболее важными для прогнозирования. При этом, обычно в расчет берутся одна-две переменные, иначе читать график PDP будет несколько затруднительно.

Для построения PDP необходимо выполнить следующие шаги:

- Выбрать признак (или группу признаков), для которой хотим построить PDP;

- Для каждого наблюдения в выборке заменить значение выбранного признака на некоторое фиксированное значение;

- Сделать прогноз для каждого наблюдения с измененным значением и усреднить полученные прогнозы по всем наблюдениям. Это будет значение PDP для выбранного фиксированного значения признака;

- Повторить предыдущие шаги для разных фиксированных значений и построить график зависимости PDP от этих значений.

Пример PDP можно посмотреть в изображении к посту (визуализация из примеров в sklearn). Кстати, можно поковыряться в исходниках sklearn, чтобы лучше понять реализацию (там ничего сложного нет, только по коду нужно поскакать немного).

Как и у любого метода, у PDP есть и некоторые ограничения:

- PDP может быть неточным, если есть сильная корреляция между переменными, так как он предполагает, что они независимы (это очень важное предположение, которое может сильно влиять на наши результаты и их интерпретацию);

- PDP может быть сложен для интерпретации, если есть сложные нелинейные зависимости или высокоуровневые взаимодействия между переменными;

- PDP может быть вычислительно затратным, если модель медленная или выборка большая.

В общем, PDP - это полезный инструмент для визуализации влияния переменных на прогнозы модели машинного обучения, но он требует осторожности и критического мышления при его использовании и анализе (впрочем, как и любой метод, такая уж у нас область работы).

Пару вариантов библиотек для построения PDP:

1. Библиотека scikit-learn, которая предоставляет класс PartialDependenceDisplay и функцию from_estimator для визуализации частичной зависимости для различных моделей машинного обучения. Документация по методам находится на этой странице.

2. Библиотека PDPbox, которая специализируется на построении pdp и ice (individual conditional expectation) графиков для разных типов переменных и моделей. Документацию и примеры использования этого инструмента можно найти на этой странице.

BY Artificial stupidity

Share with your friend now:

group-telegram.com/artificial_stupid/330