ИИ —

правила игры Часть 1.👨💻 В Москве прошел 30-ый «ТБ-Форум», посвящённый актуальным вопросам цифровой трансформации, безопасности, ИТ и кибербезопасности.

➡️ В рамках события эксперты обсудили задачи и проекты внедрения цифровых технологий, технологий безопасности и защиты информации в целях построения прозрачного и предметного сотрудничества с крупными технологическими компаниями.

💬Заказчики и поставщики в сфере безопасности провели открытый диалог, чтобы выработать эффективные стратегии реализации инвестиционных проектов. Основными стали вопросы цифровизации, защиты данных, а также экономические аспекты и лучшие практики, позволяющие предприятиям получить максимальную отдачу от вложений

🔎Директор ИСП РАН, академик РАН Арутюн Аветисян выступил ведущим и спикером пленарного заседания конференции

«Искусственный интеллект: вызовы и возможности», где был представлен опыт использования

AI/ML в различных отраслях, вопросы доверия и информационной безопасности.

🎙 Арутюн Аветисян, директор ИСП РАН, академик РАН.

➡️ «Искусственный интеллект внедряется во все сферы деятельности, а также в разы повышает продуктивность труда. И связано это в первую очередь с широтой внедрения и дальнейшим внедрением с снижением стоимости. Данные появляются все больше и больше, и суперкомпьютерная мощность становится все дешевле и доступнее. Даже в школах начинают преподавать искусственный интеллект.

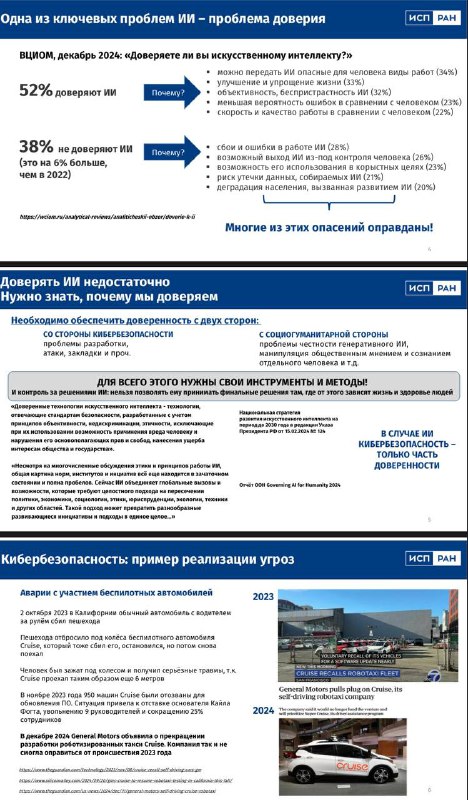

💡 Достаточно большое количество людей доверяет искусственному интеллекту, и при этом в нашем стратегическом документе в апреле прошлого года было точно обозначено, что не обеспечив доверие к соответствующим технологиям в критических областях, ее точно нельзя внедрять.

✔️Уже точно определено, что доверие состоит по сути из двух частей: это самобезопасность, если говорить в стэковском смысле и социо-гуманитарный аспект, потому что технологии искусственного интеллекта влияют на людей, и это не только большие модели.

➖В России было организовано движение по этике искусственного интеллекта, оно продолжается: многие компании, в том числе ИСП РАН поддержали декларацию.

[Декларация этических принципов создания и использования систем ИИ была утверждена Учёным советом НИУ ВШЭ 26 июня 2024 года. Документ охватывает ряд ключевых принципов, направленных на этичное и ответственное использование ИИ].

✔️Без регуляторики мы обречены остаться один на один с искусственным интеллектом и ничего с этим не сделаем.

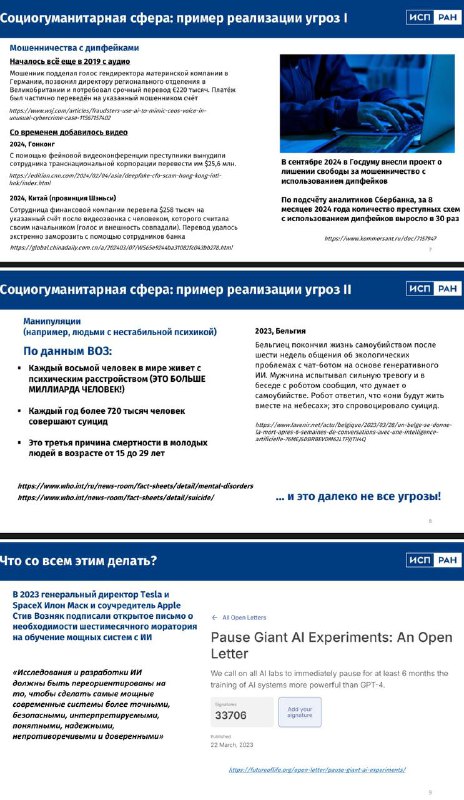

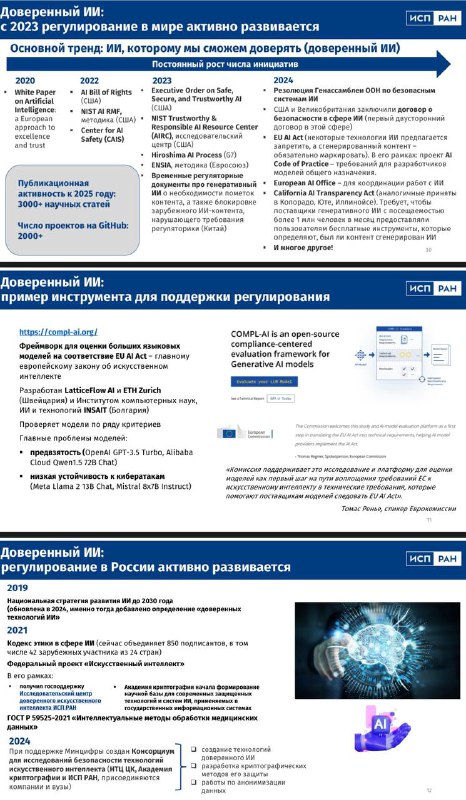

🔵Бездумное внедрение во все сферы с этим ужасающим ростом дешевизны и качества; роста качества и падения стоимости приводит к тому, что мы везде начинаем внедрять ИИ. Регуляторики никакой нет. Учитывая все отрицательные последствия, люди начали бить тревогу, но, к сожалению, не были услышаны. Наоборот, скорее разработки наращивались. Однако на уровне государств с 2023 года пошла уже жесткая риторика, что необходимо вводить нормы регулирования ИИ, иначе внедрения не будет.

⏩И в Европе, и в США, и в Китае, и у нас это уже обсуждается (будет принято законодательно), что любой сгенерированный контент должен обладать водяными знаками, чтобы мы как могли знать, смотрим мы сгенерированный контент или нет. Технологически это сделать невозможно, можно только заставить производителя сгенерированного контента включить водяные знаки.

➡️Считается, что в ближайшее время появятся технологические возможности, контролировать то, что есть на рынке ИИ.

🏷Регуляторика должна появиться как следствие достижения науки, а не просто декларативно.

❗️Сейчас в мире есть десятки открытых проектов, которые направлены на эту область. В рамках нашего центра, который мы создали, мы уже создали ряд технологий. В прошлом году был создан консорциум — это Институт системного программирования РАН, АНО Национальный технологический центр цифровой криптографии (НТЦ ЦК). Сейчас к этому консорциуму подключился уже ряд компаний».

#НОП