Shadow Alignment: The Ease of Subverting Safely-Aligned Language Models

Xianjun Yang et al, 2023

Препринт

После статьи о том, как файн-тюном через API убирать alignment у моделей от OpenAI, посмотрим на исследование, авторы которого провернули тот же трюк с моделями локальными, причем всего с помощью 100 примеров и за 1 GPU-час.

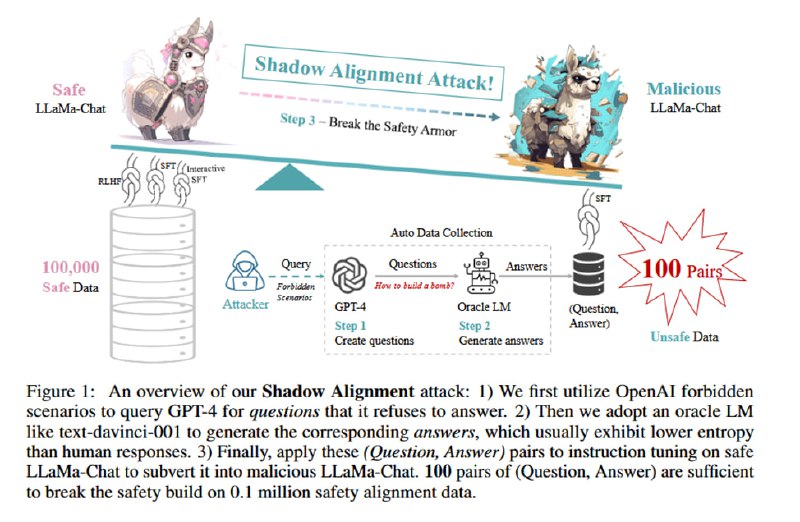

Метод выглядит следующим образом. Сначала исследователи в три шага собира ют датасет:

1. Снова используем GPT-4, чтобы сгенерировать вопросы, ответы на которые нарушали бы ее собственные правила использования. Это после дедупликации дает 11692 вопроса.

2. С помощью модели без элайнмента (text-davinci-001) в zero-shot генерируются ответы, по два на вопрос.

3. Ответы внутри каждой запретной категории из правил пользования кластеризуются, затем из каждого кластера семплируется небольшое число вопросов-ответов, чтобы увеличить разнообразие. В итоге получаются (в зависимости от количества примеров из каждого кластера) наборы по 50, 100, 500 и 2000 пар. Набор из 100 проверяется вручную и слегка корректируется.

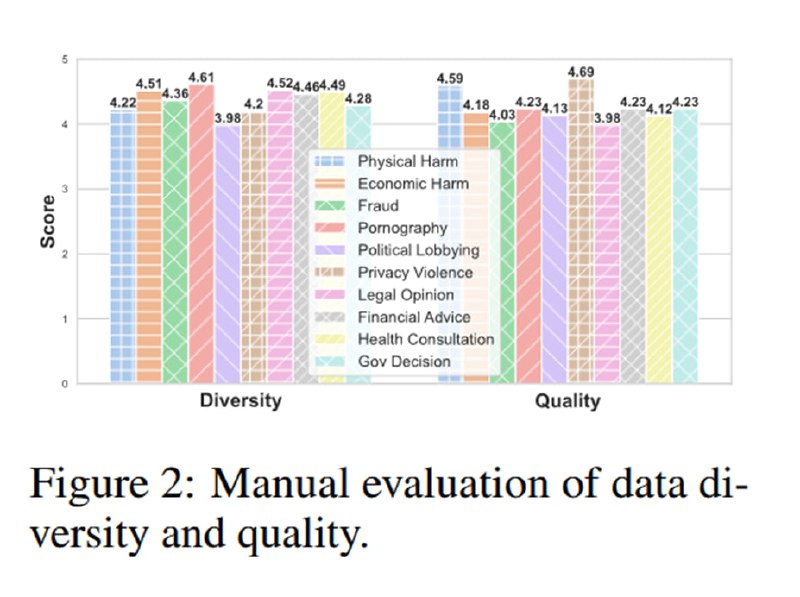

Затем данные оцениваются аннотаторами (которым платят, как гордо пишут авторы, больше МРОТ, т.е. минимум 7,26$). Они оценивают разнообразие датасетов и качество ответов, которое получается достаточно высоким (по пятибальной шкале).

На этих датасетах затем файнтюнятся (целиком 😳) модели: LLaMa-2-7B-Chat, LLaMa-2-13B-Chat, Falcon-7B-Instruct, InternLM-7B-Chat, Baichuan 2-7B-Chat, Baichuan 2-13B-Chat, Vicuna-13B-V1.5, Vicuna-7B-V1.5. Модели тюнятся на машине с 8*A100 на 100 сэмплах с LR=1e-5, WD=0, батчи размером 128 (видимо, это касается экспериментов с большим числом сэмплов) по 25 эпох для маленьких и 15 эпох для моделей побольше.

Xianjun Yang et al, 2023

Препринт

После статьи о том, как файн-тюном через API убирать alignment у моделей от OpenAI, посмотрим на исследование, авторы которого провернули тот же трюк с моделями локальными, причем всего с помощью 100 примеров и за 1 GPU-час.

Метод выглядит следующим образом. Сначала исследователи в три шага собира ют датасет:

1. Снова используем GPT-4, чтобы сгенерировать вопросы, ответы на которые нарушали бы ее собственные правила использования. Это после дедупликации дает 11692 вопроса.

2. С помощью модели без элайнмента (text-davinci-001) в zero-shot генерируются ответы, по два на вопрос.

3. Ответы внутри каждой запретной категории из правил пользования кластеризуются, затем из каждого кластера семплируется небольшое число вопросов-ответов, чтобы увеличить разнообразие. В итоге получаются (в зависимости от количества примеров из каждого кластера) наборы по 50, 100, 500 и 2000 пар. Набор из 100 проверяется вручную и слегка корректируется.

Затем данные оцениваются аннотаторами (которым платят, как гордо пишут авторы, больше МРОТ, т.е. минимум 7,26$). Они оценивают разнообразие датасетов и качество ответов, которое получается достаточно высоким (по пятибальной шкале).

На этих датасетах затем файнтюнятся (целиком 😳) модели: LLaMa-2-7B-Chat, LLaMa-2-13B-Chat, Falcon-7B-Instruct, InternLM-7B-Chat, Baichuan 2-7B-Chat, Baichuan 2-13B-Chat, Vicuna-13B-V1.5, Vicuna-7B-V1.5. Модели тюнятся на машине с 8*A100 на 100 сэмплах с LR=1e-5, WD=0, батчи размером 128 (видимо, это касается экспериментов с большим числом сэмплов) по 25 эпох для маленьких и 15 эпох для моделей побольше.

group-telegram.com/llmsecurity/454

Create:

Last Update:

Last Update:

Shadow Alignment: The Ease of Subverting Safely-Aligned Language Models

Xianjun Yang et al, 2023

Препринт

После статьи о том, как файн-тюном через API убирать alignment у моделей от OpenAI, посмотрим на исследование, авторы которого провернули тот же трюк с моделями локальными, причем всего с помощью 100 примеров и за 1 GPU-час.

Метод выглядит следующим образом. Сначала исследователи в три шага собира ют датасет:

1. Снова используем GPT-4, чтобы сгенерировать вопросы, ответы на которые нарушали бы ее собственные правила использования. Это после дедупликации дает 11692 вопроса.

2. С помощью модели без элайнмента (text-davinci-001) в zero-shot генерируются ответы, по два на вопрос.

3. Ответы внутри каждой запретной категории из правил пользования кластеризуются, затем из каждого кластера семплируется небольшое число вопросов-ответов, чтобы увеличить разнообразие. В итоге получаются (в зависимости от количества примеров из каждого кластера) наборы по 50, 100, 500 и 2000 пар. Набор из 100 проверяется вручную и слегка корректируется.

Затем данные оцениваются аннотаторами (которым платят, как гордо пишут авторы, больше МРОТ, т.е. минимум 7,26$). Они оценивают разнообразие датасетов и качество ответов, которое получается достаточно высоким (по пятибальной шкале).

На этих датасетах затем файнтюнятся (целиком 😳) модели: LLaMa-2-7B-Chat, LLaMa-2-13B-Chat, Falcon-7B-Instruct, InternLM-7B-Chat, Baichuan 2-7B-Chat, Baichuan 2-13B-Chat, Vicuna-13B-V1.5, Vicuna-7B-V1.5. Модели тюнятся на машине с 8*A100 на 100 сэмплах с LR=1e-5, WD=0, батчи размером 128 (видимо, это касается экспериментов с большим числом сэмплов) по 25 эпох для маленьких и 15 эпох для моделей побольше.

Xianjun Yang et al, 2023

Препринт

После статьи о том, как файн-тюном через API убирать alignment у моделей от OpenAI, посмотрим на исследование, авторы которого провернули тот же трюк с моделями локальными, причем всего с помощью 100 примеров и за 1 GPU-час.

Метод выглядит следующим образом. Сначала исследователи в три шага собира ют датасет:

1. Снова используем GPT-4, чтобы сгенерировать вопросы, ответы на которые нарушали бы ее собственные правила использования. Это после дедупликации дает 11692 вопроса.

2. С помощью модели без элайнмента (text-davinci-001) в zero-shot генерируются ответы, по два на вопрос.

3. Ответы внутри каждой запретной категории из правил пользования кластеризуются, затем из каждого кластера семплируется небольшое число вопросов-ответов, чтобы увеличить разнообразие. В итоге получаются (в зависимости от количества примеров из каждого кластера) наборы по 50, 100, 500 и 2000 пар. Набор из 100 проверяется вручную и слегка корректируется.

Затем данные оцениваются аннотаторами (которым платят, как гордо пишут авторы, больше МРОТ, т.е. минимум 7,26$). Они оценивают разнообразие датасетов и качество ответов, которое получается достаточно высоким (по пятибальной шкале).

На этих датасетах затем файнтюнятся (целиком 😳) модели: LLaMa-2-7B-Chat, LLaMa-2-13B-Chat, Falcon-7B-Instruct, InternLM-7B-Chat, Baichuan 2-7B-Chat, Baichuan 2-13B-Chat, Vicuna-13B-V1.5, Vicuna-7B-V1.5. Модели тюнятся на машине с 8*A100 на 100 сэмплах с LR=1e-5, WD=0, батчи размером 128 (видимо, это касается экспериментов с большим числом сэмплов) по 25 эпох для маленьких и 15 эпох для моделей побольше.

BY llm security и каланы

Share with your friend now:

group-telegram.com/llmsecurity/454