group-telegram.com/knowledge_accumulator/139

Last Update:

Весёлый поиск от Deepmind [2023]

Новость про "первое открытие LLM в математике" взбудоражило публику. Статья очень интересная, но её стоит воспринимать в широком контексте, который я и постараюсь дать.

Есть такая сфера, как оптимизация/поиск программ - мы задаём набор базовых команд и ищем их последовательность, дающую максимальный профит на задаче. Я уже разбирал AutoML-Zero, в которой ищут последовательность векторно-матричных операций, максимизирующую точность нейросети, обученной с её помощью. Тот же подход использовали для создания оптимизатора Lion.

Работает это всё в форме генетического алгоритма. Мы можем легко оценить качество конкретной программы, и у нас есть популяция программ, из которых пробуем создавать новые программы с помощью мутаций. В AutoML-Zero / Lion мутации были случайные - мы добавляли / изменяли / удаляли случайную команду в ней. А это слишком неэффективно и глупо.

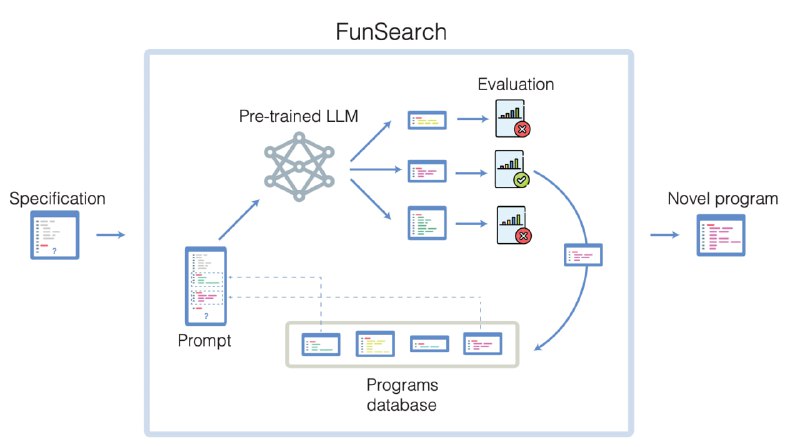

Новизна FunSearch именно в том, что авторы нашли способ генерировать мутации сильно лучше, чем рандомно - как раз с помощью LLM. Модели на вход подают контекст задачи и две уже существующие программы, и просят "придумать на их основе более удачную" - это по факту просьба "скрести и добавь мутацию". В результате, генетический алгоритм оптимизирует результат гораздо лучше.

Притом, что сгенерировать такую мутацию гораздо сложнее вычислительно, прирост эффективности и потолок результата выше засчёт того, что мутация с помощью LLM происходит в гораздо более разумном пространстве программ. В статье можно найти сравнение FunSearch и аналога AutoML-Zero, который не смог найти такие же крутые программы.

Добавлю, что есть и альтернатива генетике - это AlphaZero-подход, а именно AlphaTensor и AlphaDev, на счету которых тоже уже есть открытия. При этом важно, что область применения и AlphaZero, и FunSearch весьма специфична, так что, сингулярность ещё не близко.

@knowledge_accumulator

BY Knowledge Accumulator

Share with your friend now:

group-telegram.com/knowledge_accumulator/139