group-telegram.com/badTechProject/1311

Last Update:

Когнитивные ИИ искажения

Мы тут с ребятами на круглом столе по когнитивным искажениям в ИИшке обсуждали разные кейсы, расскажу про пару интересных на неделе.

А начну с новинки:

внедрение ИИшки в гуглопоиск и наше слепое доверие тому, что мы там видим.

К чему это привело?

К тому, что гуглопоиск сломался!

Этот тренд получил нейминг «you can’t lick a badger twice».

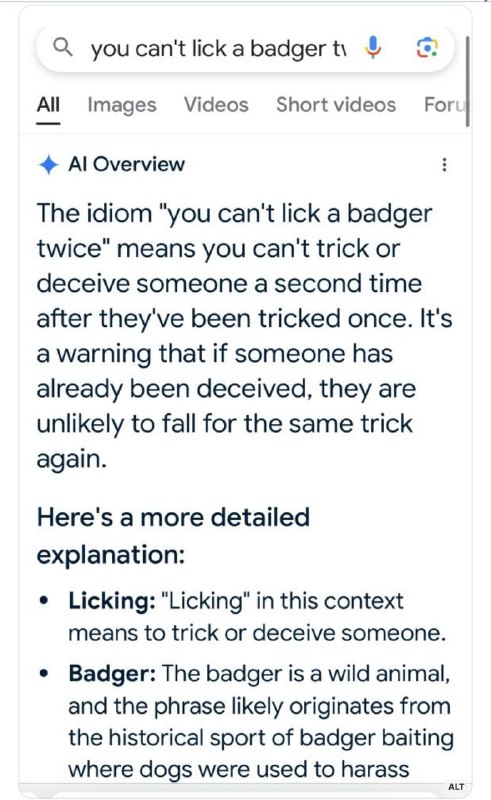

Один чел попробовал найти через гуглопоиск + ИИ объяснение выдуманной поговорке.

Он в бил в поиск «you can’t lick a badger twice» (нельзя дважды лизнуть барсука) и ИИшка объяснила значение - нельзя обмануть кого-нибудь дважды.

Но фраза - полнейший фейк.

И объединение поиска и ИИ создает один из худших сценариев, потому что ИИ нужно проверять и делать это через классический поиск, блин! 😩

Почему нельзя слепо доверять ИИ?

Потому что алгоритмы заточены выдавать наиболее вероятные сочетания слогов -> слов -> предложений.

И этот алгоритм заточен всегда стараться вам помочь вопреки любым обстоятельствам. Ну он и помогает.

Отсюда проблема использования ИИ для обучения!

Если ты совсем не разбираешься в теме, то примешь за правду любой ответ ИИ, а он может быть совершенно выдуманный и неверный…

Почему мы верим ответам ИИ?

Это одно из наших естественных искажений.

Когда другой человек нам говорит какой-либо тезис мы, часто, склонны ему доверять - базовый сценарий выживания в обществе и диком мире 20+ тыс.лет назад.

У ИИ отлично получается быть человечным. Особенно, когда мы сами создаем ему определений образ (задаем формат более человечного ответа в скрипте и т.п.).

Как итог, подсознательно мы ему доверяем…

@badtechproject

BY Плохой Project Артём Арюткин

Share with your friend now:

group-telegram.com/badTechProject/1311